大規模言語モデル(LLM)の進化を語る際、世論は「パラメータ数(モデルサイズ)」という数字に熱狂しがちです。しかし、現場でモデルを組み上げるシニア・リサーチエンジニアの視点は全く異なります。

モデルがいかに巨大であっても、そこに流し込むデータが「ゴミ」であれば、出力される知性もまた「ゴミ」でしかありません。これは計算機科学の聖典とも言える原則、「Garbage In, Garbage Out(ゴミを入れればゴミが出る)」の帰結です。真の知性は、膨大な生データをいかに洗練された「教科書」へと昇華させるかという、泥臭い前処理の技術によって決まるのです。

本稿では、一般にはあまり語られない、知性の限界を突破するための5つの技術的インサイトを解き明かします。

--------------------------------------------------------------------------------

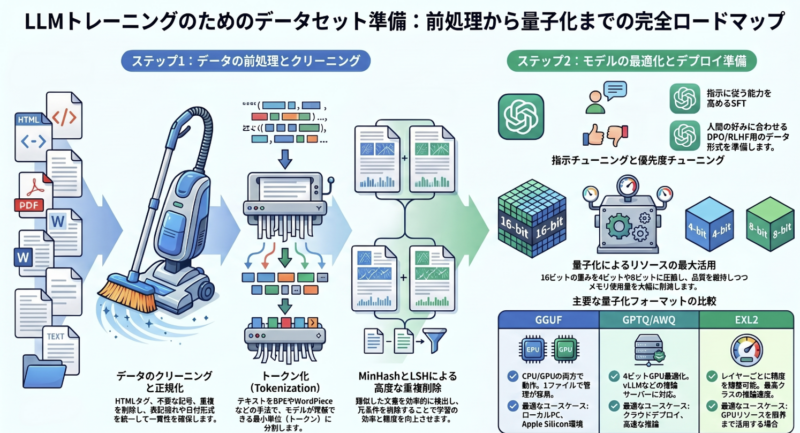

1. 重複データは「毒」になる:MinHashとCCNetによる徹底的なクリーニング

トレーニングデータにおける「重複」は、単なるストレージの無駄ではありません。それはモデルの学習効率を著しく低下させ、特定のデータに対する不当な「バイアス」や「丸暗記」を植え付ける毒となります。

業界のゴールドスタンダードであるCCNetパイプラインでは、例えば30TBもの膨大なウェブデータを1,600以上のシャードに分割し、分散並列処理で重複を排除します。ここで鍵となるのが、MinHashとLSH(Locality Sensitive Hashing:局所性鋭敏ハッシュ)です。

- MinHashの仕組み: 文書を「シングル(n-gram)」に分解し、ハッシュ関数を用いて文書間のJaccard類似度を効率的に推定します。全単語を比較するのではなく、ハッシュ署名(シグネチャ)を比較することで、数十億規模の文書ペアを現実的な時間で処理可能にします。

- LSHの役割: シグネチャを「バケット(桶)」に振り分け、同じバケットに入ったものだけを比較対象とすることで、計算コストを劇的に抑えつつ類似文書を特定します。

エンジニアの視点:粒度のトレードオフ 近年、Llama 3のように「文レベル」での重複排除を行うケースが増えています。しかし、文単位で削りすぎると段落の「一貫性」や「文脈」が損なわれ、モデルの読解能力に悪影響を及ぼすリスクがあります。リサーチエンジニアは、常に「重複排除の徹底」と「文脈の保存」という相反する要求の境界線で戦っているのです。

--------------------------------------------------------------------------------

2. 量子化の「スイートスポット」:なぜQ6_Kがプロダクション環境の正解なのか

LLMの推論パフォーマンスを決定づけるのは、実は演算能力(FLOPS)ではなく、VRAMから重みデータを読み出す速度、すなわち「Memory Wall(メモリの壁)」です。量子化とは、重みの精度をFP16(16ビット)から落とすことでデータの転送効率を上げ、推論速度を爆発させる技術です。

ここで注目すべきは、NVIDIA Blackwell世代(RTX 5090等)で導入されたNVFP4(4ビット浮動小数点)と、伝統的なQ6_K(6ビット整数量子化)の比較です。

量子化ビット数と品質・推論性能の相関(8Bモデル基準)

| フォーマット | メモリ使用量 | 品質維持率 | ハード推論(理系能力)回復率 | 推論速度(目安) |

| BF16 (Baseline) | 16.4 GB | 100% | 100% | 基準 |

| Q8_0 | 8.5 GB | ~99.5% | ~99% | ~1.5倍 |

| Q6_K (GGUF) | 6.7 GB | ~98% | ~98% | ~2.0倍 |

| Q4_K_M | 4.7 GB | ~95% | ~90% | ~2.5倍 |

| NVFP4 (Hardware) | 6.4 GB | ~97.5% | ~80% (大幅低下) | ~2.3倍 |

シニアエンジニアの分析: NVFP4はハードウェアネイティブで高速ですが、ソースデータが示す通り、数学オリンピック(AIME24)や高度な論理推論(MMLU-Pro)において、精度が80%程度まで急落する傾向があります。一方で、Q6_Kは、ほぼすべてのタスクで98%以上の精度を維持しつつ、速度を2倍に引き上げます。日本語のような低リソース言語では、量子化のダメージが顕著に出やすいため、プロダクション環境における「究極のスイートスポット」は今なおQ6_Kにあると言えます。

--------------------------------------------------------------------------------

3. KVキャッシュの限界を突破する:MLAによる「省エネ」知性

モデルが長文(ロングコンテキスト)を処理する際の最大の障害は、過去の情報を保持する「KVキャッシュ」の肥大化です。従来のMulti-Head Attention(MHA)では、コンテキストが長くなるほどVRAMを食いつぶし、スループットが低下します。

これを解決するのが、DeepSeek V2で採用されたMulti-head Latent Attention(MLA)です。

- 低ランク行列分解: MLAは、Key(K)とValue(V)をそのまま保存するのではなく、圧縮された「潜在ベクトル(Latent vector)」として保存します。

- RoPE(回転位置埋め込み)の分離: 潜在空間への圧縮において最大の問題となるのが、位置情報(RoPE)の扱いです。MLAでは、位置情報を適用する「非潜在(Non-latent)部分」を別途設けることで、計算効率を落とさずに位置的一貫性を維持しています。

エンジニアの視点:数学的エレガンス MLAの美しさは、推論時に「共有された潜在ベクトルのみをキャッシュすれば良い」という点にあります。これによりキャッシュサイズを劇的に削減しつつ、行列の結合(Merging)によって演算コストを最小化できます。このアーキテクチャこそが、LLMを「重い知性」から「軽快な知性」へと変貌させる鍵となります。

--------------------------------------------------------------------------------

4. 日本語LLMの宿命:英語とは根本的に異なる「トークナイズ」の壁

日本語のデータ準備には、英語にはない「泥臭い」コストが伴います。英語はスペース区切りのBPE(Byte Pair Encoding)で容易に処理できますが、日本語は分かち書きがないため、MeCabやSudachiなどの形態素解析器を用いた正規化が不可欠です。

- 表記揺れというノイズ: 「コンピュータ」と「コンピューター」、「color」と「colour」といった表記揺れは、適切に正規化されない限り、モデルにとって「別の概念」としてエンベディングベクトル空間の異なる位置に配置されます。これはモデルの学習容量の無駄遣いです。

- 「トークナイズ税」: 日本語のトークナイズが不適切(一文字単位など)だと、同じ意味を伝えるのに必要なトークン数が増え、学習・推論の計算コスト(およびVRAM消費)が英語よりも高くなる「税金」を払うことになります。

シニアエンジニアの分析: 「全角・半角の統一」や「送り仮名の正規化」といった地味な作業こそが、モデルの「概念の理解」を深める基盤です。日本語LLMの勝敗は、アルゴリズム以上に、この言語特有の複雑さをいかにクリーンに処理したかで決まるのです。

--------------------------------------------------------------------------------

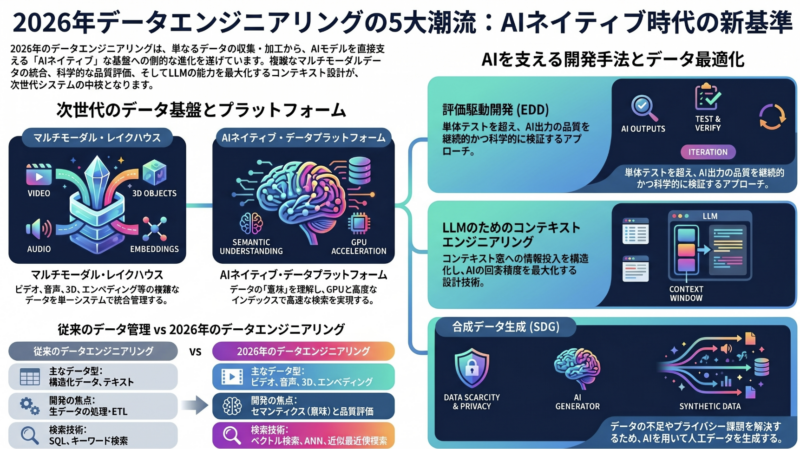

5. AIがAIを育てる:Self-Instructによる高品質な「合成データ」の生成

高品質なデータの不足は、現代のLLM開発における最大のボトルネックです。そこで、LLM自身にトレーニングデータを生成させるSelf-Instruct技術が台頭しています。

単にデータを増やすのではなく、そこには洗練された戦略が存在します。

- Input-First Approach: 数学や計算問題など、入力(問い)から出力(答え)が論理的に導かれるタスクに適した手法。

- Output-First Approach: 分類タスク(感情分析など)において、まず「ラベル(出力)」を定義し、それに合致する「入力(テキスト)」を生成させる手法。これにより、データセットのラベルバランスを意図的に制御できます。

エンジニアの視点:未来のデータ構築 合成データは「量」を埋めるための代用品ではなく、人間が書いたテキストに含まれるバイアスを「中和」し、論理的整合性を「強化」するためのツールです。AIがAIのための「より優れた教科書」を執筆する。このサイクルこそが、人間によるスケーリングの限界を超え、AIの知性を次のステージへと押し上げる原動力となります。

--------------------------------------------------------------------------------

結論:未来への展望と問いかけ

LLMの性能は、パラメータ数という「器」だけで決まるものではありません。データの重複排除、精緻な量子化の選択、KVキャッシュの構造的最適化、そして言語特有の泥臭い前処理。これらの技術の集積こそが、AIの知性の限界値を決定づけます。

今、AI開発の主戦場は「データの量」から「データの質」へと完全に移行しました。

最後に、エンジニアとして皆さんに問いかけます。 「私たちが日々インターネット上に放流している膨大なテキストのうち、未来のAIの『教科書』として残すべき価値があるものは、一体どれくらいあるでしょうか?」

質の高いデータこそが、人類の知を次世代のAIへと受け継ぐための、唯一の架け橋なのです。