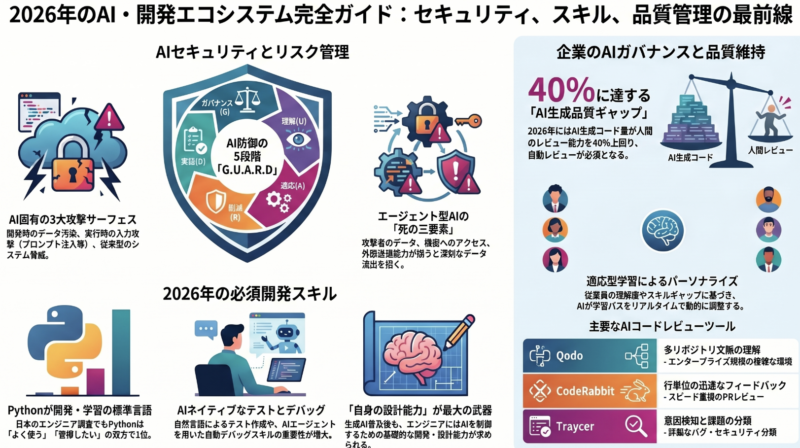

OWASP AI Exchange:包括的なAIセキュリティフレームワーク=「総合的なAIセキュリティフレームワーク」、つまりは、OWASP(オワスプ:ソフトウェアのセキュリティ向上を目的とする国際的な非営利団体)が提供している、AIシステムにおける脆弱性や脅威、その対策などを網羅的にまとめたガイドラインや情報共有の基盤を指します。AIの開発や運用に関わる開発者・セキュリティ担当者にとって、非常に重要なリファレンスとなっています。

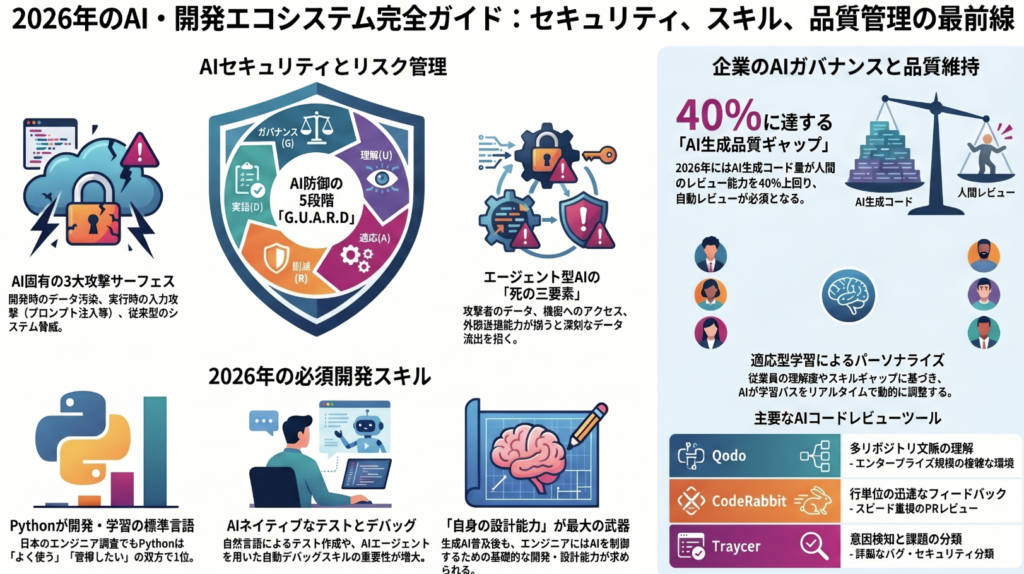

2026年AI技術の進展と、それに伴うエンジニアのキャリアやセキュリティ上の課題を包括的に概説しています。OWASP AI Exchangeは、AI特有の脅威やプライバシー保護、リスク管理のための標準的なフレームワークを提示し、組織的な安全対策の重要性を説いています。一方で、AIによるコード生成の急増が品質管理の負担を増大させている現状を指摘し、効率的な開発を維持するための高度なコードレビューツールの役割を解説しています。また、技術者向けの調査結果からは、Pythonの根強い人気や、生成AI時代に求められる能力として「自身の設計・開発力」が最重視されている実態が示されています。初心者の学習指針としては、データサイエンスの基礎とLLMの活用を組み合わせた段階的なロードマップが推奨されています。総じて、AIを効果的に活用するためには、技術習得とセキュリティ管理の双方が不可欠であることを示唆しています。

2026年のAI開発:効率の裏に潜む「5つの衝撃的な真実」とエンジニアの生存戦略

1. はじめに:AIが日常となった世界の「新たな歪み」

2026年、AIはもはや「未来のテクノロジー」ではなく、水道や電気と同じ「基盤」となりました。開発現場ではAIがコードを書き、テストを回し、デバッグを支援するのが日常です。しかし、この劇的な効率化の影で、かつて誰も予想しなかった「新たな歪み」がエンジニアリングの本質を侵食し始めています。

開発スピードが加速する一方で、なぜプロジェクトの不確実性は高まり続けているのか。私たちが手にした強大な力の裏側にある、2026年のエンジニアが直面している「衝撃的な真実」を解き明かします。

2. 効率の罠:AIコード生成が「レビューの限界」を突破する

AIによるコーディング支援は、個人の生産性を25〜35%向上させました。しかし、ここで皮肉なパラドックスが生じています。生成されるコード量が、人間が責任を持って精査できる限界を超えてしまったのです。

- AIコード生成ギャップ(AI Code Generation Gap): 2026年現在、AIが生成するコード量は人間のレビューキャパシティを40%も上回ると予測されています。

- 「欠落したコンテキスト」の代償: ソースによれば、AIがコード品質を低下させていると感じるエンジニアの44%が、その原因に「コンテキストの欠如」を挙げています。AIは局所的な最適解は出せても、システム全体の意図までは汲み取れないのです。

GoogleのVP、Megan K氏はこう断言しています。

「AIが書くコードはそのままではプロダクション対応ではありません。一見正しくテストをパスしても、そこには潜在的なセキュリティ上の欠陥やパフォーマンスの劣化、アーキテクチャの一貫性の欠如が潜んでいます」

もはや、人間によるレビューがソフトウェア開発ライフサイクル(SDLC)全体のボトルネックとなっているのが、2026年の冷酷な現実です。

3. エージェント型AIに潜む「致命的な三要素(Lethal Trifecta)」

AIが自律的にタスクを遂行する「エージェント型AI(Agentic AI)」が普及したことで、脅威モデルは劇的に複雑化しました。特に、データ漏洩を招く「Lethal Trifecta(致命的な三要素)」は、全エンジニアが把握すべきリスクです。

以下の3要素が揃ったとき、システムは壊滅的な打撃を受けます。

- データ(Data): 間接的なプロンプト・インジェクション(Indirect Prompt Injection)が仕込まれた外部データの取り込み。

- アクセス(Access): エージェントが機密情報や基幹システムへアクセスできる権限。

- 送信能力(Send): AIが外部へ情報を発信できてしまう機能。

ここで重要なのは、「アクセス制御の責任をAIモデル自体に負わせてはならない」という鉄則です。2026年の設計スタンダードは、AIを盲信しない「最小権限の原則(Least Model Privilege)」と、被害を最小限に食い止める「影響制限(Blast Radius Control)」の徹底に集約されます。

4. 結局、最後に勝つのは「エンジニア自身の設計力」である

「AIがあればプログラミングの知識は不要になる」――かつて囁かれたその予測は、2026年のエンジニア白書(Qiita調査)によって完全に否定されました。AIツールがコモディティ化するほど、皮肉にも「人間由来の力」の価値が暴騰しているのです。

- 最重要スキルは「設計力」: 調査において、49%のエンジニアがAI時代に最も必要なスキルとして「自身の開発・設計能力」を挙げ、AIリテラシー(39%)を大きく上回りました。

- 継続的な学習: また、28%のエンジニアが「学習し続ける姿勢」を重要視しています。

AIが吐き出した膨大なコードの「正しさ」を審判し、堅牢なアーキテクチャに統合する力。この「基礎力の再定義」こそが、2026年を生き残る唯一の戦略です。

5. 「シャドーAI」を止める唯一の解決策:禁止ではなく「高品質な代替」

組織内での未許可のAI利用「シャドーAI」に対し、禁止令を出すのは石器時代の管理手法です。現場は利便性のために、セキュリティを容易にバイパスします。

- セキュアな代替手段の提供: 組織が提供するAIモデルは、従業員が外部の公開ツールを使いたいと思わないほど**「十分に高品質」**である必要があります。利便性で劣るツールは、シャドーAIを防げません。

- 既存セキュリティの拡張: AIセキュリティは、完全に新しい概念ではありません。基本的には「従来のセキュリティプログラム」の延長線上にあるものです。

- Assume Zero Trust(ゼロトラストの前提): 「マーフィーの法則」に従い、AIは必ず誤り、必ず漏洩させる可能性があると仮定したガードレールを敷くべきです。

「AIを信じない」設計こそが、組織を最も安全に、かつ効率的に前進させるエンジンとなります。

6. 結論:AIと共に歩む2026年以降のロードマップ

2026年、AIは魔法ではなく、私たちが使いこなすべき強力かつ危ういツールとしての地位を確立しました。開発効率の向上という「光」が強いほど、セキュリティリスクや技術的負債という「影」もまた深くなっています。

技術の進化に身を委ねるのではなく、AIが出力する結果にエンジニアとしての誇りと責任を持ち続けること。その姿勢こそが、2026年以降のキャリアを決定づけます。

最後に、読者の皆さんに問いかけます。

「AIがあなたの代わりにコードを書くとき、あなたはそのコードの『責任』をどこまで負う覚悟がありますか?」