1. 2026年におけるコンテキスト管理の戦略的転換

2026年、企業のAI戦略の成否は「モデルの規模」ではなく「コンテキスト管理」の質によって決定づけられます。現在、企業の91%がAIエージェントのナレッジ管理を最優先課題として挙げていますが、現実は深刻です。最新の調査によれば、61%の組織がデータへの信頼性不足を理由にAIプロジェクトを延期しており、87%がデータ不足を本番運用の主要なブロック要因として報告しています。

CIOが直面しているのは、単なる技術的な課題ではありません。ガバナンスを欠いたAI利用は、もはや管理不可能な「技術負債」の域を超え、企業の存続を揺るがす「法的リスク」へと変貌する境界線にあります。今、ITリーダーに求められているのは、受動的なメタデータ管理から脱却し、AIエージェントがリアルタイムで信頼できる情報を活用できる**「コンテキストの活性化(Context Activating)」**をデータガバナンスと統合することです。

信頼できるデータ(Trusted Data)の安定的供給こそが、ハルシネーションを構造的に排除し、意思決定の自動化における唯一の競争優位性を生むのです。本ロードマップは、2026年の技術潮流を捉え、無秩序なAI利用を「知能のインフラ」へと昇華させるための不可欠な指針です。

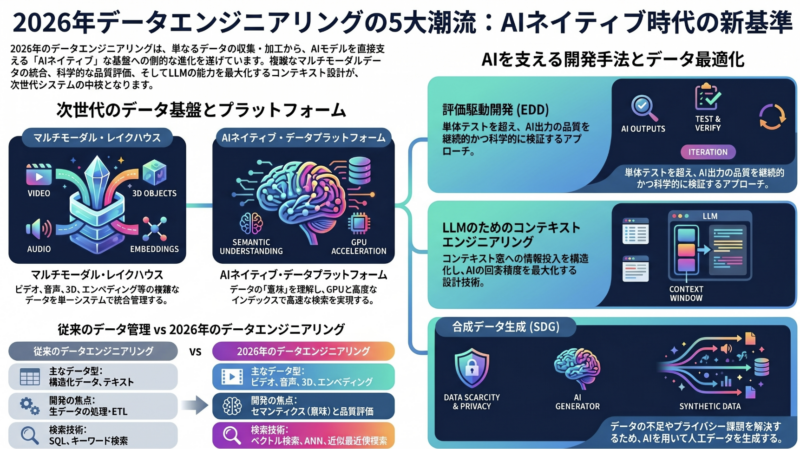

2. 2026年の主要トレンド:AIネイティブなデータエンジニアリングの台頭

2026年のデータエンジニアリングは、「AIが解釈可能な文脈(コンテキスト)」をいかに設計するかに集約されます。以下の5大潮流を統合的に実装することは、もはや選択肢ではなく義務です。

- Evaluation-Driven Development (EDD): 「YOLO(一発勝負)プロンプトエンジニアリング」の時代は終わりました。統計的に検証された評価テスト(Eval)を開発の中核に据え、AIシステムの品質を客観的に保証する手法への移行が必須です。

- Context Engineering: プロンプトエンジニアリングは一時的な「絆創膏」に過ぎません。対してコンテキストエンジニアリングは、チャンキング、メモリ管理、リトリーバルルーティングを設計し、入力エコシステム全体を最適化するAIシステムの「免疫システム」です。

- Multimodal Lakehouse: ビデオ、音声、ベクトル埋め込み(Embeddings)を二次的ファイルではなく「コアデータ」として扱うアーキテクチャです。ベクトル検索をストレージエンジンに直接統合することで、非構造化データの高度な推論を可能にします。

- AI-Native Data Platforms: 構造化データと非構造化データの双方をセマンティックに理解し、GPU加速化された検索とハイブリッドクエリによって、ビジネス文脈に即した情報抽出を極小のレイテンシで実現します。

- Synthetic Data Generation (SDG): データ不足やプライバシー制約を克服するため、アルゴリズムが生成する合成データを活用し、希少ケースの補完やモデルの精度検証を加速させます。

戦略的要諦: これらAIネイティブな基盤とコンテキストエンジニアリングが組み合わさることで、**「AIのためのゼロトラスト・データ(Zero-Trust Data for AI)」**が確立されます。Multimodal Lakehouseに格納された生データが、EDDによる統計的検証を経て初めてエージェントに供給されるクローズドループを構築することで、ハルシネーションのリスクをアーキテクチャによって構造的に封じ込めることが可能となります。

3. 主要コンテキスト管理プラットフォームの比較評価

組織の技術スタックと規制要件に基づき、最適なプラットフォームを選択するための意思決定マトリクスを以下に提示します。

| プラットフォーム | 主要な特性 | 適合する組織・要件 |

| DataHub | LinkedIn由来。1.4万人以上のコミュニティが支えるオープンソース基盤。メタデータグラフによる高度な可視性。 | スケールとガバナンスを両立し、ベンダーロックインを回避したい先進的企業。 |

| Collibra | 金融・ヘルスケア等の規制業界に特化。厳格なデータ・スチュワードシップとポリシー執行、監査証跡。 | 高度なコンプライアンスとトレーサビリティが経営上の最優先事項である組織。 |

| Informatica IDMC | CLAIRE AIによる自動化。MDM、データ品質管理を含むエンドツーエンドの統治。 | 不均一なマルチソース環境を持つ大規模エンタープライズ。 導入コストより規模の経済を重視する組織。 |

| Microsoft Purview | Azure、M365とのネイティブ統合。機密データの自動分類と情報保護。 | Azure OpenAI等のMicrosoftエコシステムを主軸にAI開発を推進する組織。 |

| Neo4j | グラフデータベースによるGraphRAG。複雑な多段階推論(Multi-hop)を可能にするナレッジグラフ。 | 説明可能性(Explainability)を重視し、複雑な関係性に基づく高度な推論を求めるチーム。 |

選定の評価軸(Product-Market Fit): ツール選定は機能の羅列で行ってはなりません。データ品質、系統(Lineage)、アクセス制御が「コア機能」として組み込まれていないツールは、AIエージェントを「資産」ではなく「法的負債」に変えるリスクがあります。

4. 信頼できるAIのためのデータ・メッシュとDDD(ドメイン駆動設計)の統合

2026年、AIの信頼性を担保するのは技術だけではありません。組織的な「社会技術的アプローチ」としてのデータ・メッシュとDDDの統合が不可欠です。

- ユビキタス言語の遵守と「portion」の罠: 現場で使われる「chunk(分割された断片)」という言葉を、ビジネス側に配慮して「portion」と言い換えるような抽象化は、致命的な**「負の遺産」**となります。コード内ではportion、会話ではchunkという二重構造は認識の齟齬を生みます。PdMとエンジニアが同じ部屋で共通言語をコードに直接反映させることが、コンテキストの純度を保つ唯一の道です。

- データ製品(Data Product)としての統治: データセットを単なるテーブルではなく、所有者、SLA、品質スコア、メタデータを備えた「製品」として定義します。これにより、AIが消費する情報の「製造責任」を明確化します。

- 境界付きコンテキスト(Bounded Context)による汚染防止: DDDの戦略的設計を用い、各ドメインのAIコンテキスト間に明確な境界線を引きます。これがない場合、あるドメインの不正確なデータが他のエージェントの推論プロセスを破壊する**「コンテキストの汚染(Semantic Contamination)」**が発生し、システム全体の信頼性が崩壊します。

5. ハルシネーション抑制とコンプライアンス:合成データと評価サイクルの実装

AIエージェントの品質管理には、LLMを「審判」として組み込んだ科学的な評価サイクルが必要です。

- 評価主導開発(EDD)の実装: LLMを「Judge(評価者)」として活用し、検索結果の関連性や回答の正確性を0〜3のスケールで統計的にスコアリングします。このフィードバックループをCI/CDに組み込むことで、プロンプトやデータの変更が精度に与える影響を即座に可視化します。

- 合成データによるエッジケース克服: 希少な症例や異常取引など、実データが不足している領域を合成データ(SDG)で補完します。これにより、個人情報を保護しつつ、AIの推論限界を安全にテスト・拡張することが可能になります。

「データさえあればAIは動く」という幻想を棄却し、「評価(Eval)を開発のコア」に据えてください。これが結果的に、無駄な試行錯誤による開発コストと、ハルシネーションによるブランド毀損リスクを最小化する唯一の手段です。

6. 実装ロードマップ:12ヶ月のフェーズ別実行計画

Phase 1 (Month 1-3): 基礎確立

- 重点目標: ドメインの特定、ユビキタス言語の定義、メタデータカタログの選定。

- アクション: 専門チームによる「chunk」等の用語定義の統一。PdMとエンジニアの直接対話環境の整備。

- ROIの観点: 用語の不一致に伴う手戻り時間を[X]%削減。初期的なガバナンス基盤による開発スピードの向上。

Phase 2 (Month 4-6): データ製品のパイロットリリース

- 重点目標: 最初のAIコンテキスト用「データ製品」のリリースとSLA設定。

- アクション: パイロットドメインにおけるSLA(鮮度・正確性)の公開。

- ROIの観点: 手動でのプロンプト調整時間の削減。特定ユースケースにおけるAI精度の安定化による、ビジネス部門の信頼獲得。

Phase 3 (Month 7-12): スケールと自動化

- 重点目標: 計算ガバナンス(Policy-as-code)の導入とEDDによる継続的改善。

- アクション: LLM Judgeによる0-3スケール評価の自動化。大規模なデータ製品の公開。

- ROIの観点: システム的な信頼性(Systemic Reliability)の確立。認定済みデータ製品の再利用により、新規AIエージェントの展開コストを劇的に低減。ハルシネーションに起因する「エラーのコスト(法的・賠償的損失)」を予防。

結論

本ロードマップの完遂は、単なるツールの導入ではなく、2026年以降のビジネスにおける「知能のインフラ」の確立を意味します。統治されたコンテキストを供給し続ける体制こそが、AIエージェントを企業の最大資産へと変貌させるのです。