2026年、AIインフラの現場は「モデルの精度競争」から、自律的なAIエージェントが経済活動を行う「エージェント・インフラ(Agentic Infrastructure)」の構築へと完全にシフトしました。現在、バックエンド・アーキテクトに求められるのは、Pythonで書かれた「知能(モデル)」を、いかに堅牢でスケーラブルな「神経系(インフラ)」で包み込むかという視点です。

本ガイドでは、2026年現在の主要技術スタックを俯瞰し、RustとGoのどちらを選択すべきか、実務的な洞察に基づき解説します。

1. 2026年のAIインフラにおける言語選択の重要性

現代のAIシステムは、PyTorch/TensorFlowが支配する「モデル層」と、リクエストを捌く「基盤・インフラ層」に二分されています。2026年の特筆すべき変化は、AIエージェントが自らx402プロトコルを通じてAPI決済を行い、自律的にタスクを完遂する「Agentic GDP」の台頭です。

この環境下では、単なるAPIの受け渡しだけでなく、ミリ秒単位の判定と極めて高いリソース効率が、システムの収益性(経済的実行可能性)を直接左右します。zeroclawやironclaw、googleworkspace/cliといった2026年を象徴するRust製インフラのリポジトリが爆発的な支持を得ているのは、単なる流行ではなく、インフラ層に求められる「信頼性」の基準が上がったからです。

AIインフラの5つの主要ワークロード

シニア・アーキテクトとして、我々が直面するワークロードは以下の5点に集約されます。

- LLMゲートウェイ / ルーター: 複数のモデル(OpenAI, Anthropic, 自社モデル)へのリクエストを制御し、認証とレート制限を行う心臓部。

- トークン・ストリーミング: 長時間生存するSSE/WebSocket接続を維持し、トークンをリアルタイムで届ける。

- テレメトリ (OTel) スパン処理: 秒間数百万のスパンを収集し、エージェントの挙動を可視化・分析する。

- ベクトル検索のホットパス: 膨大な次元の埋め込みベクトルに対し、SIMD命令を活用して高速検索を行う。

- プロンプト・テンプレート処理: 複雑な命令文の組み立てとトークナイズ、コンテキストパッキングの並行処理。

これらに対し、どちらの言語が最適か。単なるベンチマークを超えた「実務上のボトルネック」の視点から評価していきます。

--------------------------------------------------------------------

2. ワークロード別:RustとGoの適性評価

LLMゲートウェイ / リバースプロキシ

よく「RustはGoより速い」と言われますが、ゲートウェイにおいてスループットの差は「誤差(Rounding Error)」に過ぎないことが多いのが現実です。2026年のフロントエンド・モデルの応答時間は依然として800〜2000msであり、言語による数ミリ秒の差は上流の遅延に埋もれます。 ただし、**p99(テールレイテンシ)**を重視するなら話は別です。GoのGCによる一時的なスパイクを許容できない「金融系エージェント」や「リアルタイム制御」では、Rustが唯一の選択肢となります。

トークン・ストリーミング

数万の同時接続を維持するSSE環境において、メモリ消費量はコストに直結します。Goのgoroutineは1つあたり約2KBと極めて軽量ですが、Rustはさらにその30〜50%少ないメモリで動作可能です。DiscordがかつてGoからRustへ一部移行した際の「特定のGCポーズが特定のメトリクスを損なう」という教訓は、2026年の大規模ストリーミング環境でも有効な指標です。

OpenTelemetry (OTel) スパン処理

秒間100万件を超えるようなハイパースケールなインジェスト環境では、GoのGC負荷が無視できないオーバーヘッドとなります。Rustはゼロコピー・デシリアライゼーションにより、Goと比較して30〜60%のスループット向上を見込めます。ただし、標準的な規模であれば、実装が容易なGoのOTel Collectorで十分です。

ベクトル検索のホットパス

検索エンジンの「核(カーネル)」となる演算では、RustのSIMD(一括計算命令)制御が圧倒的な勝利を収めます。一方で、検索エンジンの周囲にあるメタデータフィルタリングやネットワーク処理といった「接着剤(Glue)」の部分は、Goの生産性が勝ります。MilvusがGoとC++を組み合わせているように、現代の設計は適材適所です。

プロンプト・テンプレート処理

文字列操作の頻度が高いこのワークロードでは、アロケータの効率が問われます。Rustはコンパイル時にメモリ管理を決定するため、高負荷時のメモリプロファイルが極めて平坦です。

比較まとめテーブル(2026年実務基準)

| ワークロード | Goの評価 | Rustの評価 | 判断の決め手 |

| LLMゲートウェイ | 優 (生産性重視) | 極 (p99安定) | 1200msの待機中に数ミリ秒を惜しむか |

| ストリーミング | 極 (同時接続に強い) | 優 (省メモリ) | 1接続あたりのメモリコスト |

| テレメトリ処理 | 良 (標準的) | 極 (高効率) | 秒間100万スパンを超えるかどうか |

| ベクトル検索 | 中 (Glue用途) | 極 (Kernel用途) | 自作エンジンか、既存製品の活用か |

| プロンプト操作 | 優 (直感的) | 極 (無駄なし) | 文字列churn(生成・破棄)の激しさ |

次のセクションでは、これらの性能差を享受するために支払うべき「開発コスト」の現実について触れます。

--------------------------------------------------------------------

3. パフォーマンス指標と開発体験(DX)のトレードオフ

「速い」ことは正義ですが、エンジニアリングには常にコストが伴います。

- テールレイテンシの真実: GoのGCは2026年現在も進化していますが、数ミリ秒の停止(Stop-the-world)は構造上避けられません。一方、RustはGCなしで安定したパフォーマンスを提供します。しかし、「計測せよ、推測するな」。あなたのシステムでGCポーズが実際にユーザー体験を損なっていないなら、Rustへの移行はオーバースペックかもしれません。

- メモリ効率と所有権の格闘: Rustはメモリを30〜50%節約しますが、その代償としてエンジニアは「借用チェッカー」という厳しい規律に従う必要があります。Goなら1日で書き上がるプロトタイプに、Rustでは3日かかることも珍しくありません。

- Mojoの台頭: 2026年には「Pythonの書きやすさでC++の速度を出す」MojoがAIロジック層で有力な選択肢となっています。システム基盤はRust、AI演算カーネルはMojo、全体を束ねるバックエンドはGo、というハイブリッド構成が現実味を帯びています。

シニアの視点: 「Goは1日で動くものが作れるが、Rustは3日かけて絶対に壊れないものを作るための言語だ。」

--------------------------------------------------------------------------------

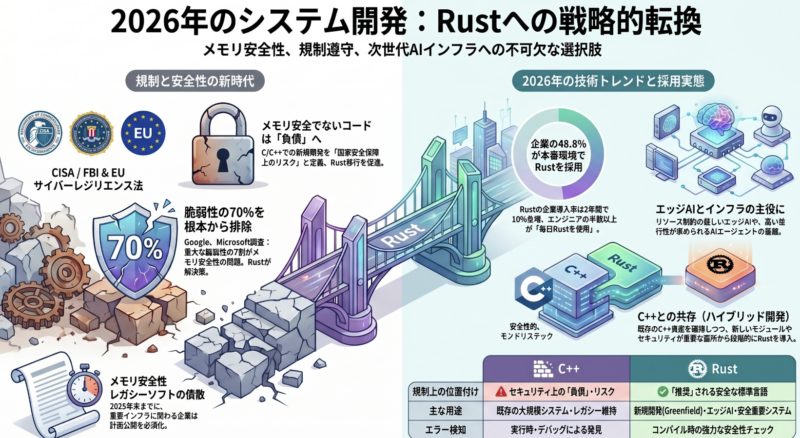

4. 2026年の法的規制と安全性への要求(Safety-Critical)

2026年において、メモリ安全性の欠如はもはや「技術的な不備」ではなく、**「法的リスク」**として定義されています。

- CISA/FBIの「Bad Practice」指定: 米国政府機関は、重要なインフラにおいて新しくC/C++でコードを書くことを「Bad Practice(悪習)」と断じました。2025年末までに「メモリ安全性ロードマップ」を公開していない企業は、公共案件から排除されるリスクを負っています。

- EUサイバーレジリエンス法 (CRA): 欧州市場では、脆弱性に対する製造物責任が厳格化されました。Rustを採用し、メモリ由来の脆弱性(CVEの約70%)をコンパイル時に排除することは、最も安価な「コンプライアンス保険」と言えます。

- セーフティ・クリティカルの進化: 自動車(ISO 26262)や医療機器分野では、Ferrocene(安全性 qualifiedなRustツールチェーン)の普及とSafety-Critical Rust Consortiumの活動により、RustがC言語の代替として標準採用され始めています。

--------------------------------------------------------------------------------

5. 結論:AIインフラ初学者のための言語選定ロードマップ

言語の選択に迷ったら、以下のチェックリストを埋めてみてください。

Goを選ぶべき場合

- [ ] チームを急拡大させる必要があり、学習コストを最小化したい。

- [ ] 上流のLLM API(OpenAI等)の待ち時間が支配的で、自前のロジックは薄い。

- [ ] Kubernetesエコシステムとの密接な統合が最優先事項である。

- [ ] まずはプロトタイプを爆速でデプロイし、市場の反応を見たい。

Rustを選ぶべき場合

- [ ] リアルタイム・ストリーミングで、GCによる一瞬のカクつきも許されない。

- [ ] エッジデバイス(ESP32-S3等)やリソース制限の厳しい環境でAIを実行する。

- [ ] EU CRAやCISA等の法規制への対応が求められるミッションクリティカルな領域。

- [ ] 自律型AIエージェント(aGDP)が秒間数千件の判断を行う高頻度・低遅延インフラ。

アーキテクトからの最終アドバイス: 「2026年のスタンダードは、Serving Layer(提供層)のGo、Hot Path(演算・高負荷層)のRustというハイブリッド戦略です。すべてのコードをRustで書く必要はありません。ボトルネックを計測し、痛みが走っている場所からRust(あるいはMojo)を注入する。この『実利的なリアリズム』こそが、2026年のエンジニアに求められる最高のスキルです。」