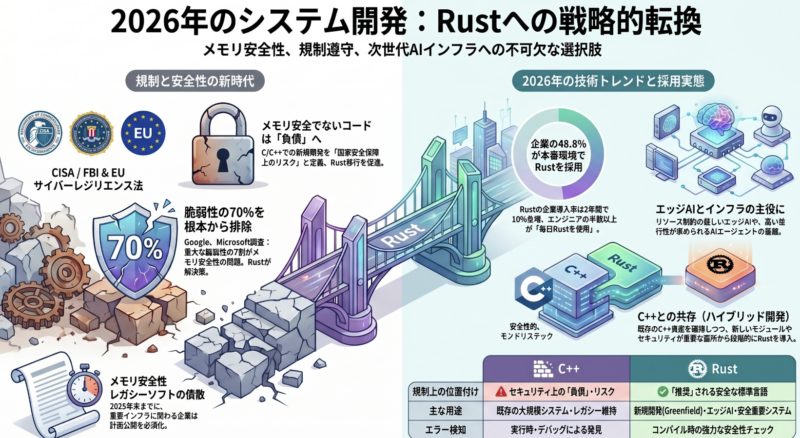

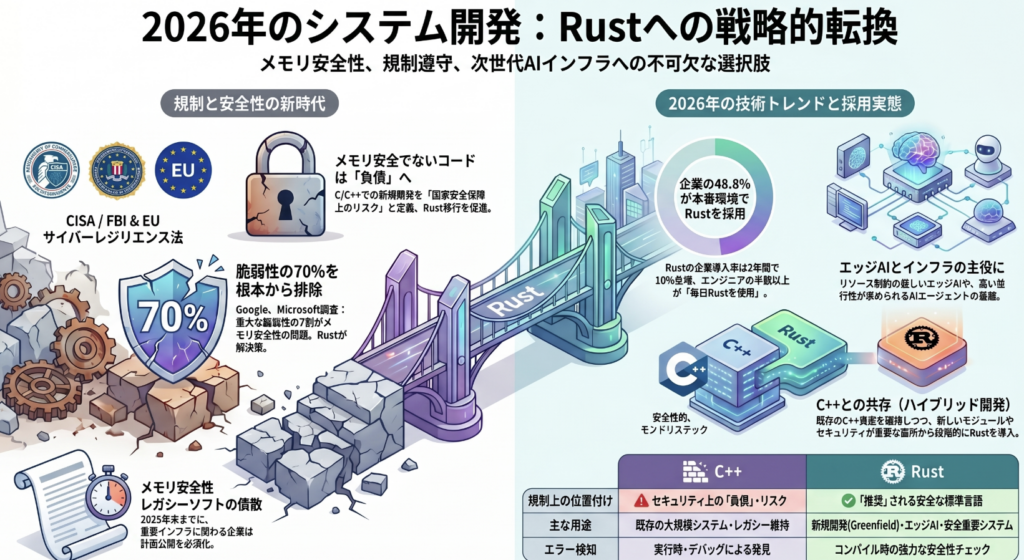

2026年における組み込みシステムとシステムプログラミングの主要トレンドについて多角的に分析しています。特に、Rust言語がメモリ安全性を武器に、従来のC/C++に代わって安全性重視の産業やAIインフラ、GitHub上のオープンソース開発で急速に普及している現状を報告しています。一方で、低レイテンシが求められる現場では依然としてC++が主流であり、Rustの本格導入にはツールチェーンの認定やエコシステムの成熟が課題であることも指摘されています。また、エッジAIの最適化やRISC-Vの台頭、Zephyr RTOSの標準化といった、次世代のハードウェアおよびソフトウェア設計を形作る重要な要素についても議論が交わされています。全体として、技術的な信頼性が不可欠な領域において、開発の効率化と安全性の両立を目指す業界の転換期が描かれています

AIインフラやエージェント開発でRustが選ばれる背景は?

2026年現在、AIインフラや自律型AIエージェントの開発においてRustが急速に採用されている背景には、主に以下の4つの強力な理由があります。

1. 実環境の操作に伴う「絶対的な安全性」の要求 かつてのAIエージェントはテキストを生成するだけでしたが、現在はシェルコマンドの実行、プロセス管理、ブラウザの操作、さらには特権モードでのシステム操作など、実環境に直接介入するレベルへと進化しています。このような自律型エージェントにおいて、メモリ安全性やプロセスの分離は「あれば望ましいもの」ではなく、システムの暴走や重大なセキュリティ侵害を防ぐための「絶対的な要件」となっています。Rustはコンパイル時にメモリ安全性を保証するため、この要件を満たす最適な言語として選ばれています。

2. Pythonの限界の打破と極めて高いパフォーマンス AIインフラ層において、RustはPythonのグローバルインタプリタロック(GIL)の制約を打破し、真の並列実行と予測可能なメモリレイアウトを提供します。また、Rustはガベージコレクション(GC)を持たないため、GCの停止による予測不可能な遅延スパイクが発生しません。ミリ秒単位のテイルレイテンシ(遅延のブレ)の制御が求められるAIゲートウェイや、大量のエージェントを並列で実行するインフラにおいて、Rustのパフォーマンスは大きな武器となります。

3. 単一バイナリによる展開の容易さ(クロスプラットフォーム) 最新のAIエージェントインフラは、クラウドだけでなく、MacBook、Raspberry Pi、ヘッドレスサーバーなど、あらゆるプラットフォームで動作することが求められます。Pythonの場合は仮想環境や複雑な依存関係の管理が必要になりますが、Rustはランタイムの依存関係がない単一の静的バイナリにコンパイルできるため、どこにでも簡単にデプロイできる点がインフラ構築において高く評価されています。

4. AIテクノロジースタックにおける明確な役割分担の進行 これらの要因から、AI開発の現場では言語の明確な棲み分けが進んでいます。AIモデルの学習やファインチューニング、スクリプト層のフレームワークは引き続きPythonが担う一方で、エージェントを実際に実行するための「ランタイム層」や「OS・サンドボックス層」はRustで記述されるようになっています。たとえば、AIエージェントと外部ツールを安全かつ高速に接続・処理する「Model Context Protocol (MCP)」のサーバー実装などにも、軽量で並列処理に強いRustが選ばれています。

Go言語との使い分けやベンチマークの差は?

2026年のAIインフラやバックエンド開発において、RustとGo言語は競合するというよりも、それぞれの強みを活かした「明確な棲み分け」が完了しています。

開発現場での使い分けの基準と、実際のベンチマークの差は以下の通りです。

1. ベンチマークとパフォーマンスの差

全体として、純粋なスループットやリソース効率ではRustが優位に立ちます。

- スループットと処理速度: あるベンチマーク環境では、HTTPスループットがRustで約89万リクエスト/秒に対し、Goは約73万リクエスト/秒という結果が出ており、TechempowerのJSONシリアライズ等のテストでも、GoはRustのトップフレームワークの50〜70%程度のスコアに落ち着くことが多いです。また、プロンプトのテンプレート処理などでは、RustがGoの1.5〜3倍高速に動作します。

- メモリ消費量: Rustはガベージコレクション(GC)を持たないため、Goと比較してメモリ消費量が40〜60%少なく済む傾向があります。1万の同時接続を維持するテストでは、Rustが45MB、Goが78MBのメモリを消費したというデータもあります。

- テイルレイテンシ(遅延のブレ): ここが最大の違いです。Goは優れたGCを持っていますが、高負荷時にはGCの停止によって2〜5ミリ秒程度の遅延のブレ(スパイク)が発生します。ミリ秒単位の安定性が求められる場合、P99(上位1%の遅延)レイテンシでRust(2.1ms)がGo(3.8ms)を上回るなど、Rustの「完全にフラットなレイテンシ」が大きな強みとなります。

2. 開発現場での使い分けの基準

ベンチマークではRustが優位ですが、実際のAIインフラ構築においては「すべてをRustで書く」のは推奨されていません。

Go言語が選ばれるケース(全体の約80%を占める)

- APIゲートウェイや周辺サービス: 多くのAIプロダクトでは、遅延の大部分(数百〜数千ミリ秒)は上流のAIモデル(LLM)の応答待ちが占めます。そのため、数ミリ秒の言語間の速度差はプロダクト全体に影響を与えず、Goの性能で十分すぎると判断されます。

- 開発速度とオンボーディング: Goはコンパイルが数秒で終わり(Rustは数十分かかることも)、学習曲線も緩やかです。また、Goroutineを使えばトークンストリーミング(SSE)のような大量の同時接続も容易に実装できます。

- インフラとの親和性: Kubernetesを中心としたクラウドエコシステムとの相性が極めて良いため、標準的なマイクロサービスはGoが第一選択となります。

Rustが選ばれるケース(インフラのコア・残り20%)

- 極限のパフォーマンスが求められる部分: 5ミリ秒以下のテイルレイテンシが製品要件になっている場合や、秒間数十万のスパンを処理するようなハイパースケールのデータ取り込み。

- CPUバウンドな処理: ベクトル検索エンジンのコア部分や、複雑なフィルタリング、SIMD命令を多用するような計算処理では、RustがGoを圧倒(冷えたカーネルで2〜3倍高速)します。

3. 主流になりつつある「ハイブリッド・アーキテクチャ」

2026年現在、多くの先進的なチームはこれらを組み合わせたアプローチを採用しています。

基本的にはサービング層やマイクロサービスの80%を開発速度に優れるGo言語で構築し、システム内で最も負荷が高い(あるいは遅延が許されない)「ホットパス」と呼ばれる15〜20%のコアコンポーネントのみをRustで記述し、gRPCやFFI(Foreign Function Interface)を通じて連携させるという設計です。

これにより、Goによる「チームの開発ベロシティ(速度)」と、Rustによる「絶対的なパフォーマンスと安全性」の両立を図っています。